O kompetencjach orędowników energetyki jądrowej | prof. Mirosław Dakowski

21 minut

21 minut

Tylko głupiec nie słuchałby Jego każdego słowa.

Posted by Marucha w dniu 2024-05-09 marucha

Można stracić życie albo trzeba dać łapówkę w kwocie od 5 do 10 tysięcy euro.

Znajoma Ukrainka, pracowita i zaradna, sympatyczna, pracowała we Wrocławiu jako sprzątaczka. Zarabiała dość sporo pieniędzy, ale może jednak za mało, by ‚wykupić’ dwóch synów, którzy pozostawali na Ukrainie. Wyjechała do Niemiec i dość szybko synowie mogli opuścić kraj ‚walczący za Europę’ (a więc i za Polskę). Nie każdy jednak może pozwolić sobie na taki wydatek.

Wielu Ukraińców, którzy znaleźli się już na froncie, ma szansę poddać się rosyjskiemu oddziałowi, ale też można zginąć od rosyjskiej kuli albo być trafionym w plecy podczas ucieczki na drugą stronę. Banderowskie bataliony czuwają nad dyscypliną żołnierzy, którzy jednak nie chcą ginąć za Zełenskiego i kijowski reżim. Jeszcze można przepłynąć rzekę Cisę i o tym jest w poniższym krótkim tekście:

Utonęło sześciu kolejnych Ukraińców podczas ucieczki do UE

Cisa stanowi granicę między Ukrainą a Unią Europejską. Część Ukraińców, chcąc uniknąć wojny i mobilizacji, próbuje przeprawić się przez rzekę. W rezultacie część z nich umiera w wodzie. Ukraińska straż graniczna niemal codziennie aresztuje osoby próbujące przedostać się przez Cisę do Rumunii. Podobno niektórzy z nich próbowali przeprawić się przez rzekę, mimo że nie umieli pływać.

Według władz rumuńskich od początku wojny ponad 6 tysięcy osób próbowało przekroczyć rzekę, granicę z Rumunią – podaje ‚The New York Times’. Część z nich korzysta z pontonów i materacy. Nie wszyscy przeżyli. Mężczyźni umierają m.in. z powodu wychłodzenia.

Według ukraińskiego dziennikarza w poniedziałek z rzeki wydobyto sześć kolejnych ciał, cztery po stronie ukraińskiej i dwa po rumuńskiej. „Jeden z mężczyzn niedawno skończył 20 lat” – napisał na Telegramie Witalij Głagoła, ostrzegając przed niebezpieczeństwami związanymi z przeprawą przez zdradliwą górską rzekę.

W poniedziałek ukraińska straż graniczna oficjalnie potwierdziła śmierć mężczyzny w średnim wieku, na którego ciele widoczne były oznaki długotrwałego przebywania w wodzie. Ciało odkryli rumuńscy koledzy po drugiej stronie granicy.

„Pomimo niższego poziomu wody przeprawa przez rzekę, jak każdy inny nieznany zbiornik wodny, pozostaje niebezpieczna, zwłaszcza w ciemności, gdy nieuczcwi ludzie poszukujący nielegalnego wzbogacenia się oferują swoim ofiarom przeprawę na drugą stronę” – informuje ukraińska straż graniczna. – „Rzeka jest płytka tylko po stronie ukraińskiej. Jeśli jest zimno i poziom wody się podnosi, szanse na przepłynięcie na drugą stronę są bardzo nikłe. Dlatego poszukiwania stały się częścią codziennego życia. Niektórych zaginionych nigdy nie odnaleziono”.

Opracował: Zygmunt Białas

https://zygumntbialas.neon24.net

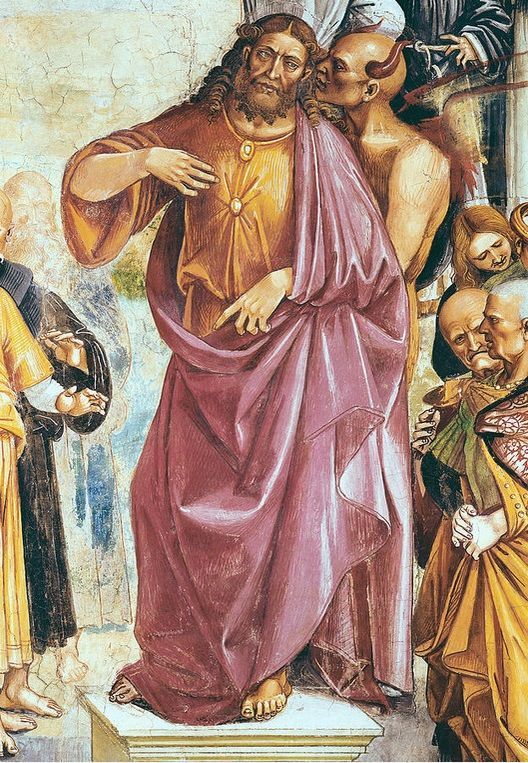

Luca Signorelli – Sermon and Deeds of the Antichrist

9.05.2024 Autor: Miroslaw Gajer czy-w-polsce-zostanie-kiedykolwiek-wybudowana-elektrownia-atomowa

W przeprowadzonym niedawno wywiadzie wybitny autorytet w dziedzinie elektroenergetyki, reprezentujący Politechnikę Łódzką profesor Władysław Mielczarski, wylał dosłownie kubeł zimnej wody na rozpalone do czerwoności głowy entuzjastów budowy w Polsce elektrowni atomowych.

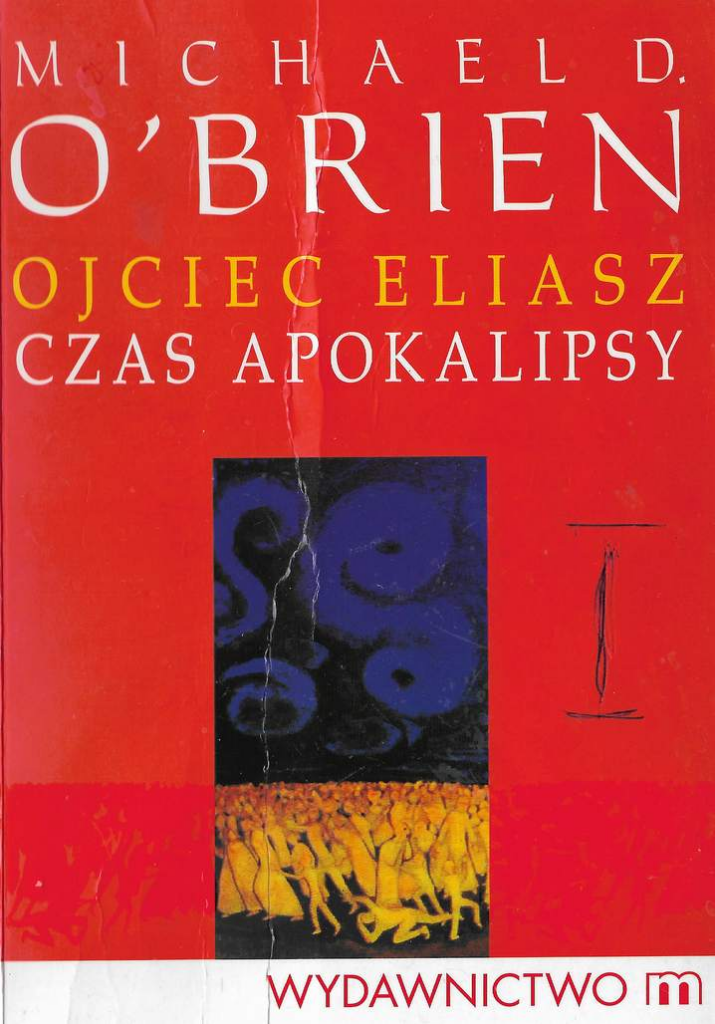

Sprawa sprowadza się głównie do tego, że zarówno w Stanach Zjednoczonych, jak i w Europie, energetyka jądrowa jest już zdecydowanie technologią schyłkową.

W Stanach Zjednoczonych nowych elektrowni atomowych nie buduje się w zasadzie już od ponad 30 lat, co dobitnie pokazuje rysunek 1, gdzie kolorem czerwonym zaznaczono skasowane projekty budowy nowych tego typu obiektów.

Tymczasem w kwestii budowy pierwszej polskiej elektrowni atomowej postawiliśmy właśnie na Amerykanów i na opracowaną przez ich firmę Westinghouse technologię reaktorów typu APD-1000. Tylko, żeby wszystko było jasne, Westinghouse tej pierwszej polskiej elektrowni jądrowej w Lubiatowie-Kopalinie w żadnym wypadku nie wybuduje, ponieważ firma ta realizacją tego rodzaju obiektów po prostu się nie zajmuje.

Od Westinghouse zakupiliśmy tylko dokumentację techniczną, czyli de facto mamy na razie jedynie kilka ton zadrukowanego papieru. Dopiero na podstawie rozważanej dokumentacji technicznej, czyli zakupionej od firmy Westinghouse technologii, tę elektrownię atomową trzeba będzie kiedyś wybudować – według optymistycznych wariantów ma to nastąpić do roku 2036.

I właśnie w tym momencie zaczynają się przysłowiowe „schody”, jak swego czasu zwykł był mawiać generał Bolesław Wieniawa-Długoszowski, zapewne uprzednio sporo wypiwszy.

Problem polega na tym, że żadna z działających na terenie naszego kraju firm nie ma większego doświadczenia w kwestiach związanych z budową tego typu obiektów. W zasadzie nie posiadamy również odpowiednio wyszkolonych w tym celu kadr, ponieważ te, które były tworzone w latach osiemdziesiątych ubiegłego wieku pod kątem budowy elektrowni atomowej w Żarnowcu, dawno już przeszły na emeryturę albo wręcz przeniosły się już do wieczności.

Tymczasem w mediach głównego nurtu sprawa budowy pierwszej polskiej elektrowni jądrowej przedstawiana jest w taki sposób, jakby miała to być budowa jakiegoś zwykłego bloku mieszkalnego, szkoły bądź co najwyżej powiatowego szpitala, a w istocie jest to bardzo złożony proces, wymagający pospinania licznych łańcuchów dostaw i odpowiedniego harmonogramowania prac. [Potrafią zbudować kładkę przez Wisłę, to co im tam „atomy”. MD]

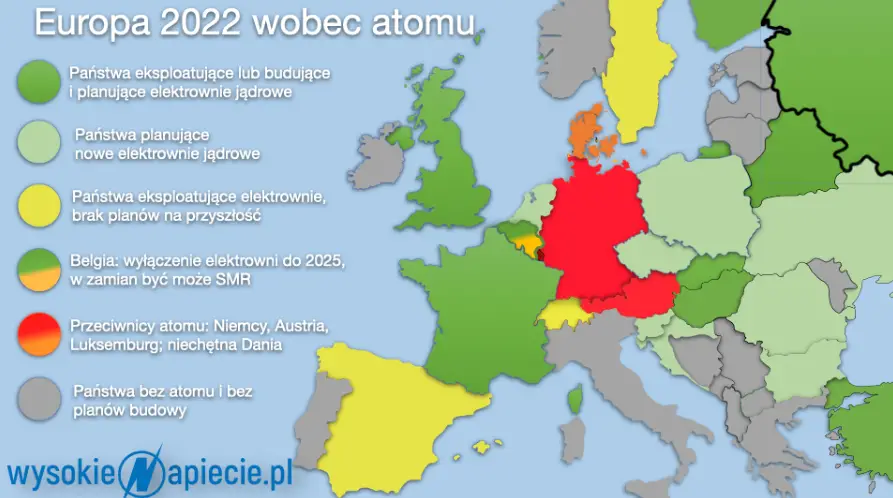

Skoro nie Amerykanie, to może ktoś inny? Tymczasem w Europie sytuacja nie wygląda o wiele lepiej, co można zobaczyć na rysunku 2. Obecnie elektrownie atomowe w Europie są w stanie wybudować jedynie Francja i Rosja. Oczywiście w naszym przypadku, w obecnej sytuacji politycznej współpraca w tym zakresie z drugim krajem nie wchodzi w ogóle w rachubę. Jednocześnie warto pamiętać, że to właśnie Rosjanie mają już w najbliższej przyszłości przystąpić do rozbudowy istniejącej od dawna w miejscowości Paks węgierskiej elektrowni jądrowej o dwa nowe bloki energetyczne o mocy 1200 MW każdy. Aktualnie Rosja buduje także elektrownię atomową w Turcji. Od Rosji paliwo jądrowe zakupuje ponadto wiele innych krajów europejskich, a także i same Stany Zjednoczone (sic!), co dla wielu czytelników może wydawać się informacją wręcz szokującą.

Potencjalnie elektrownię atomową mogliby nam wybudować Francuzi, którzy posiadają bardzo nowoczesną technologię w postaci produkowanych przez nich reaktorów typu EPR-1600. Jest tylko jeden problem związany przede wszystkim z potencjalnym czasem realizacji tego rodzaju ogromnego przedsięwzięcia. Mianowicie, budowa oddanej przez Francuzów elektrowni atomowej w Finlandii w 2023 roku rozpoczęła się jeszcze w roku 2005, czyli trwała ponad 18 lat – o wiele dłużej niż pierwotnie zakładano. Gdybyśmy zapisali się u Francuzów do kolejki na realizację elektowi atomowej w naszym kraju, to z pewnością by nam ją wybudowali, ale prawdopodobnie dopiero gdzieś w okolicach roku 2045. Jest doprawdy wielką naiwnością sądzić, że w przypadku naszego kraju proces budowy takiej elektrowni przebiegałby szybciej, niż miało to swego czasu miejsce w znacznie bardziej zaawansowanej technologicznie od nas Finlandii.

W mediach mówi się także o innej możliwości, gdyż potencjalnie chętni do wybudowania nam elektrowni atomowej we własnej technologii byliby również Koreańczycy. Jednak opcja taka wydaje się obecnie całkowicie nierealna, głównie z tego względu, że technologie koreańskie różnią się diametralnie od technologii stosowanych w Europie, to po prostu jest inna „bajka”. Uzyskanie zgody na wybudowanie na terytorium Unii Europejskiej elektrowni atomowej w technologii koreańskiej wymagałoby zdobycia wręcz niezliczonej ilości różnego rodzaju certyfikatów i pozwoleń ze strony europejskich agencji atomistycznych, a proces ten ciągnąłby się zapewne latami.

Jak wynika z zamieszczonych powyżej rozważań, nie jest rzeczą bynajmniej definitywnie już przesądzoną, że jakakolwiek elektrownia atomowa w naszym kraju w ogóle powstanie. Zresztą historia budowy elektrowni atomowej w Polsce przypomina przysłowiową pogoń za „króliczkiem”. Ale, być może, w tym całym szaleństwie jest jednak jakaś metoda, bo prawdopodobnie nie chodzi tutaj o to, aby tego „króliczka” kiedyś wreszcie złapać, ale właśnie by gonić go… A swoją drogą, ile to już miliardów złotych na to „gonienie króliczka” w Polsce wydano? Ile ktoś na tym zarobił… I co z tego w sumie mamy? Wszak na to ostatnie pytanie można odpowiedzieć zaledwie jednym rzeczownikiem…

W tym miejscu należałoby przede wszystkim postawić pytanie, po co właściwie potrzebna nam jest ta elektrownia atomowa i dlaczego koniecznie chcemy ją w naszym kraju wybudować? I właśnie tutaj dochodzimy do sedna sprawy.

Otóż przyczyną tego całego „zamieszania” i po prostu „zawracania sobie głowy” niedostępnymi dla nas obecnie technologiami jądrowymi jest podjęcie swego czasu fundamentalnej decyzji, dotyczącej całkowitego porzucenia w polskiej energetyce paliw kopalnych – w pierwszym rzędzie węgla, a następnie docelowo również i gazu ziemnego, ponieważ w zamyśle „utopistów”, którzy podpisali tego rodzaju zobowiązania, wszystko ostatecznie w Polsce ma być „zielone”, a najlepiej byłoby, gdyby już w roku 2040 emisja dwutlenku węgla została zredukowana aż o 90 proc.

Wiara w to, że taka redukcja emisji dwutlenku węgla jest w ogóle możliwa, to po prostu całkowite ignorowanie obowiązujących powszechnie w świecie, w którym żyjemy, praw fizyki. To wszystko są mrzonki i jakieś fantasmagorie, to jest po prostu niewykonalne, no chyba, że mamy cofnąć się cywilizacyjnie wręcz do epoki przedprzemysłowej, gdy antropogeniczna emisja dwutlenku węgla była jedynie śladowa.

Skoro uprzednio ktoś podpisał w imieniu narodu polskiego tego rodzaju zobowiązania, to teraz mamy przysłowiową „żabę”, którą musimy już w najbliższej przyszłości w jakiś sposób zjeść, a że w zasadzie w ogóle nie wiemy, jak ją ugryźć, próbujemy zatem dosłownie wszystkiego (choćby i energetyki jądrowej) – wszak „tonący nawet brzytwy się chwyta”.

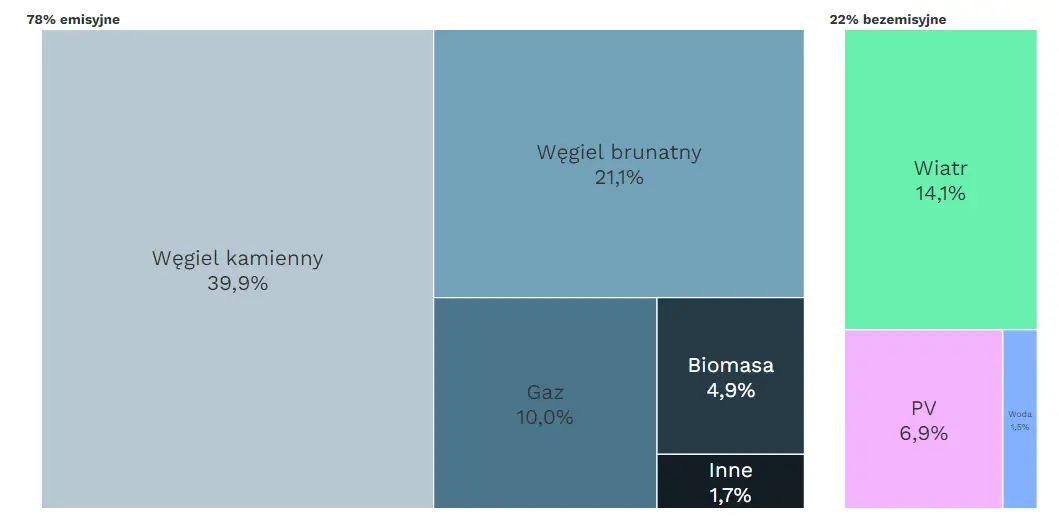

Aby zrozumieć, w czym rzecz, wystarczy spojrzeć na rysunek 3, na którym pokazano wykres, przedstawiający, jak wyglądał polski miks energetyczny w 2023 roku.

Jak widać, ze spalania węgla (kamiennego i brunatnego) pochodzi łącznie aż 61 proc. wytworzonej w Polsce energii elektrycznej. Kolejne jej 10 proc. pochodziło ze spalania gazu ziemnego, a prawie 5 proc. ze spalania biomasy. Tymczasem tzw. „bezemisyjne” źródła energii (w rzeczywistości coś takiego nie istnieje, bo co przykładowo choćby z węglem spalonym w celu wytopienia stali i wypalenia cementu na fundamenty wiatraków i budowę zapory elektrowni wodnej?) wyprodukowały zaledwie 22 proc. zużywanej w kraju energii elektrycznej.

Do ukazanych na rys. 3 bezemisyjnych źródeł energii elektrycznej zaliczane są wyłącznie elektrownie wodne, wiatrowe i fotowoltaika. Co ciekawe, nie zalicza się tam już z jakichś powodów biomasy, być może dlatego, że jest to de facto „młodsza siostra” węgla.

Udział energetyki wodnej w polskim miksie energetycznym jest znikomy (zaledwie 1,5 proc.) i nie ma żadnych możliwości istotnego zwiększenia jego udziału w przyszłości, gdyż po prostu jesteśmy krajem raczej ubogim w zasoby wodne. Z kolei fotowoltaika odpowiedzialna jest za 6,9 procent produkcji energii elektrycznej w Polsce, przy czym łączna moc zainstalowana w panelach przekroczyła już wartość 17 GW (dla porównania największa polska elektrownia w Bełchatowie ma nieco ponad 5 GW). Ktoś może naiwnie rozumować, że gdyby podwoić całkowitą moc zainstalowaną w polskich panelach fotowoltaicznych, czyli zwiększyć ją do wartości 34 GW, to automatycznie udział fotowoltaiki w polskim miksie energetycznym również ulegnie podwojeniu i osiągnie w związku z tym wartość 13,8 proc.

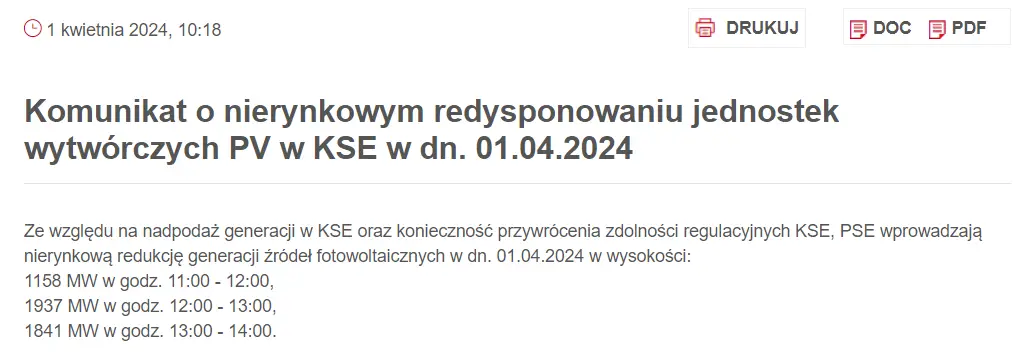

Nic bardziej mylnego! To tak po prostu nie działa. W przypadku fotowoltaiki stoimy obecnie już właściwie pod ścianą, o czym najlepiej świadczy fakt, że w marcu, czyli w okresie, gdy okres wzmożonej generacji mocy w instalacjach fotowoltaicznych właściwie na dobre nawet się jeszcze nie zaczął, Polskie Sieci Elektroenergetyczne S. A. (PSE) musiały aż w sześciu dniach tego miesiąca wydać specjalny komunikat o tzw. nierynkowym redysponowaniu mocy ze źródeł fotowoltaicznych, co po prostu sprowadza się do nakazu natychmiastowego odłączenia od sieci przesyłowych wybranych farm fotowoltaicznych. Tego rodzaju komunikat został wydany także w dniu 1 kwietnia 2024 roku i nie był to z całą pewnością prima aprilis. Z jego treścią czytelnik może zapoznać się na rysunku 4.

Analogiczny komunikat wydano zresztą w dniu 7 kwietnia 2024 roku, gdy na rynku pojawiły się przez trzy kolejne godziny ujemne ceny energii elektrycznej, co pokazano na rysunku 5. Taki stan rzeczy stanie się już prawdopodobnie żelazną regułą także i w kolejne weekendy, zapewne aż gdzieś do końca września.

Za tego rodzaju przymusowe odłączenie farm fotowoltaicznych od sieci przesyłowych ich właścicielom wypłacane jest przez PSE stosowne odszkodowanie. Takie postępowanie jest jednak absolutną koniecznością, ponieważ w przeciwnym wypadku nadmiar wprowadzonej do systemu elektroenergetycznego mocy spowodowałby dosłownie jego „eksplozję”, co skończyłoby się ostatecznie blackoutem na terenie całego kraju.

Podobnie sytuacja wygląda w przypadku elektrowni wiatrowych. W najbliższych latach postawienie kolejnych wiatraków lądowych oraz zainstalowanie ponad 7 GW w wiatrowych farmach morskich spowoduje, że w okresie przechodzenia frontów atmosferycznych kilka gigawatów generowanych przez wiatraki będzie musiało zostać przymusowo odłączonych od sieci z tego samego powodu, co wspomniana uprzednio fotowoltaika.

W związku z tym w naszym kraju nie ma już większych możliwości zwiększenia udziału w miksie energetycznym wymienionych źródeł „bezemisyjnych” – być może uda się ostatecznie uzyskać z nich łącznie około 30 proc. W ostatnim czasie różnej maści „eksperci” (najczęściej po jakichś studiach humanistycznych) głoszą powszechnie tezę, jakoby „cudownym” rozwiązaniem, pozwalającym w sposób istotny zwiększyć udział OZE w miksie energetycznym, było upowszechnienie tzw. „wielkoskalowych” magazynów energii. Osoby głoszące tego typu poglądy prawdopodobnie w ogóle nie odróżnią mocy od energii, a ponadto nie znają jednostek wielkości fizycznych i nie mają przede wszystkim pojęcia o rzędach wielkości, którymi operuje się w elektroenergetyce.

Dobowe zapotrzebowanie na energię elektryczną w Polsce przekracza wartość 500 GWh, a zdolność do magazynowania energii elektrycznej przez średniej wielkości elektrownię szczytowo-pompową Porąbka-Żar wynosi tylko 2 GWh. Gdyby jedynie 20 proc. dobowego zapotrzebowania na energię elektryczną w naszym kraju miało być pokrywane z magazynów energii (ponad 100 GWh), to takich elektrowni szczytowo-pompowych jak Porąbka-Żar potrzebowalibyśmy przynajmniej 50. Jest to ilość wręcz niewyobrażalna! W całym kraju trudno byłoby wskazać nawet tyle potencjalnych lokalizacji pod budowę takich potężnych obiektów hydrotechnicznych, a o wysiedleniu tysięcy ich mieszkańców nawet nie wspominając. Ponadto, uwzględniając fakt, że budowa elektrowni Porąbka-Żar trwała około 10 lat, to nawet gdyby budować w Polsce równolegle pięć tego typu magazynów energii, co i tak byłoby niebywałym wręcz wyczynem, to potrzebne ostatecznie 50 elektrowni szczytowo-pompowych mielibyśmy ukończone dopiero po 100 latach!

[Dodaję, bo prof. Mielczarski zawsze o tym zapomina, że są znane technologie magazynowania energii [elektrownie szczytowo – pompowe na wahania dobowe, wodór [też w magazynach podziemnych, jak metan] , metody chemiczne. Nie porównuj, Kolego, z całkowitym zapotrzebowaniem, lecz z jego wahaniami, tak dobowymi, jak sezonowymi !! MD]

Namawiam do nich „rządzących” bałwanów od 35 lat. Mirosław Dakowski].

Jeśli mamy docelowo całkowicie zrezygnować z węgla, z którego pozyskujemy 61 proc. wytwarzanej w naszym kraju energii elektrycznej, to w pierwszym rzędzie należy odpowiedzieć sobie na pytanie, czym właściwie mamy go zastąpić? Teoretycznie mógłby być to gaz ziemny, z którego pozyskujemy obecnie 10 proc. konsumowanej w Polsce energii elektrycznej. Jednak nasze krajowe zasoby tego surowca energetycznego są niewielkie i związku z tym skazani jesteśmy na jego import. Taki stan rzeczy grozi tym, że w pewnym momencie możemy znaleźć się w takiej sytuacji, jak niegdyś Władysław Gomółka, który podobno ubolewał, że „gdybyśmy mieli więcej blachy, to produkowalibyśmy więcej konserw, ino mięsa nie mamy…”. My z kolei prawdopodobnie nie mielibyśmy dodatkowych kilkunastu miliardów metrów sześciennych gazu ziemnego dla nowo wybudowanych bloków elektrowni gazowych.

Obecnie wydajemy w kraju miliardy złotych na modernizację armii, co należy uznać ze wszech miar za słusznie, ponieważ bezpieczeństwo militarne kraju jest bardzo ważne. Niestety, prawdopodobnie niewiele osób zdaje sobie sprawę, że równie ważne jest bezpieczeństwo energetyczne kraju. Zresztą oba rodzaje bezpieczeństwa są ze sobą ściśle powiązane, bo jeśli chroniczne niedostatki podaży energii elektrycznej doprowadzą finalnie do wystąpienia potężnego kryzysu i w jego efekcie upadku gospodarki całego kraju, to fakt ten wpłynie w oczywisty sposób również na zdolności obronne całego państwa. Gwałtowny spadek PKB spowoduje, że po prostu nie będzie już pieniędzy na konieczne zakupy sprzętu dla armii i utrzymanie jej odpowiednio wysokiego stanu liczebnego. Załamie się także produkcja krajowego przemysłu zbrojeniowego.

Co zatem w zaistniałej sytuacji należy zrobić? Przede wszystkim trzeba raz na zawsze porzucić mrzonki związane z utopijną wizją możliwości całkowitego odejścia w polskiej elektroenergetyce od węgla. W kroku kolejnym należy wyrzucić ostatecznie do kosza plany likwidacji największej polskiej elektrowni cieplnej w Bełchatowie. Wręcz przeciwnie, wszystkie 11 bloków tej elektrowni o mocy 360 MW powinno zostać wymienione na nowoczesne bloki nadkrytyczne o półtora razy większej sprawności, niż mają te pracujące obecnie. Po takiej wymianie całkowita moc rozważanej elektrowni powinna zostać podniesiona do przynajmniej 8 GW. W ten sposób, spalając w Bełchatowie mniej więcej tę samą ilość węgla co obecnie, otrzymalibyśmy prawie 3 GW dodatkowej mocy elektrycznej, a jest to w zasadzie tyle samo, ile wynosi moc planowanej w Lubiatowie-Kopalinie elektrowni atomowej. Czyli po wymianie bloków elektrowni w Bełchatowie na nowoczesne bloki nadkrytyczne o odpowiednio większej mocy, 3 GW dodatkowej mocy elektrycznej mielibyśmy właściwie za darmo i żadna kontrowersyjna budowa elektrowni atomowej nie byłaby w naszym kraju w ogóle potrzebna.

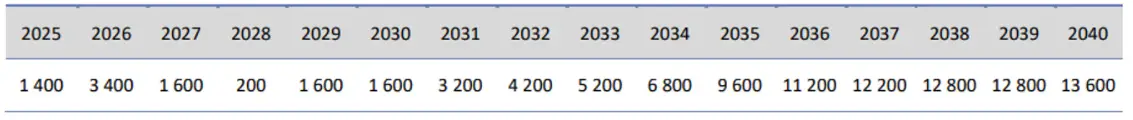

Na rysunku 6 przedstawiono przewidywania PSE odnośnie przyszłego deficytu mocy dyspozycyjnej w polskim systemie elektroenergetycznym, który wywołany będzie likwidacją elektrowni węglowych. Jak widać, w roku 2040 spodziewany jest deficyt w wysokości ponad 13 GW. Zatem, aby przywrócić bilans mocy w krajowym systemie elektroenergetycznym, trzeba będzie w tym celu wyłączyć dosłownie połowę Polski. To wywoła wręcz niewyobrażalną katastrofę!

Nawet gdyby w roku 2040 zaczęły z pełną mocą pracować wszystkie trzy bloki elektrowni atomowej w Lubiatowie-Kopalinie o łącznej mocy 3 GW, to i tak deficyt mocy dyspozycyjnej przekraczałby 10 GW – wielkość wręcz niewyobrażalna.

Warto na koniec porównać jeszcze koszty budowy elektrowni węglowych z elektrownią atomową. Otóż budowa bloku węglowego o mocy 1 GW kosztuje obecnie około 8 miliardów złotych, a koszt budowy bloku jądrowego o tej samej mocy przekracza grubo 40 miliardów.

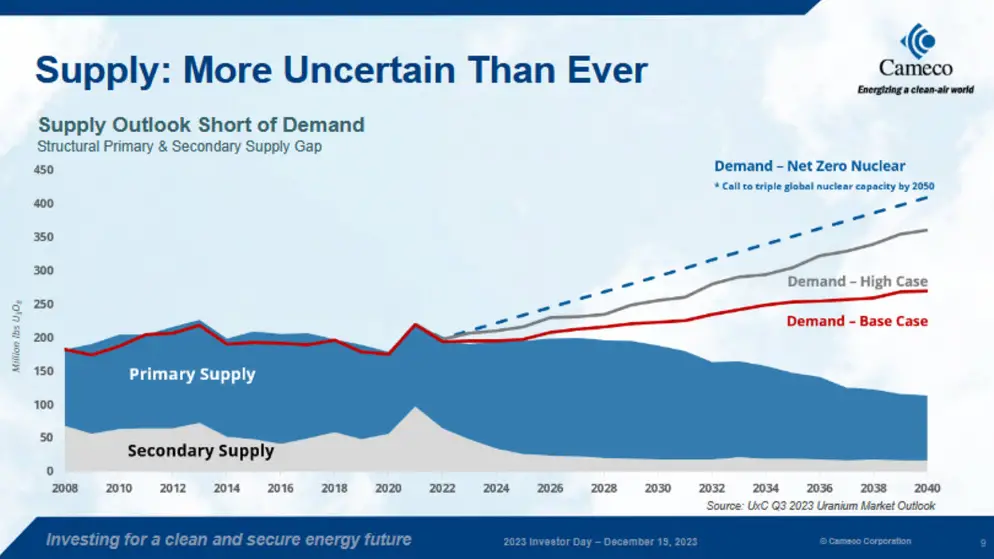

Ponadto warto jest wiedzieć, że na rynku wydobycia uranu w nadchodzących latach spodziewany jest potężny deficyt, co można zobaczyć na rysunku 7.

W związku ze spodziewanym deficytem uranu cena tego surowca energetycznego może już w niedalekiej przyszłości mocno wystrzelić w górę, ponieważ elektrownie będą skłonne zapłacić za niego dosłownie każdą cenę, bo jeśli wybudowało się już blok jądrowy za ponad 40 miliardów złotoch, to nie zrobiono to w tym celu, aby stał teraz bezużytecznie.

Zatem nasze nadzieje na tanią energię elektryczną pochodzącą z „pierwszej polskiej elektrowni atomowej” najprawdopodobniej już niedługo pękną jak bańka mydlana.

Autor: stan orda , 10 maja 2024 ekspedyt/opowiesc-o-geodetach-nieba-czyli-jak-mierzono-wszechswiat

Początek tytułowych pomiarów sięga połowy III wieku przed narodzeniem Chrystusa, czyli nieomal czasów 126 olimpiady (lata 276-273 a.Ch.n.; łac.: ante Christum natum). W miejscowości Cyrene, która wówczas była jedną z greckich kolonii na afrykańskim wybrzeżu Morza Śródziemnego, urodził się Eratostenes, który jest zaliczany do grona najwybitniejszych myślicieli czasów starożytnych (obok Archimedesa, Euklidesa, Pitagorasa i Ptolemeusza).

(Cyrene; współcześnie libijskie Shahhat, położone, mniej więcej, w połowie drogi pomiędzy miastami Banghazi (Bengazi) a Tubruq (Tobrukiem);

Eratostenes; 275-194 a.Ch.n., filozof, geograf, matematyk, poeta. Edukował się w Liceum i Nowej Akademii w Atenach. Pracował w Bibliotece Aleksandryjskiej, a po śmierci Apolloniosa z Rodos objął w niej stanowisko Głównego Bibliotekarza (lata 246 -197 a.Ch.n.).

W oparciu o największe dziedzictwo słowa pisanego w świecie antycznym, które zgromadzone zostało w zbiorach Biblioteki Aleksandryjskiej, posiadł niebywale rozległą wiedzę o współczesnym mu świecie. Mógł w tym celu korzystać z danych źródłowych, jak np. bezpośrednie relacje napisane przez podróżników, kupców, żeglarzy, a również zapiski dowódców wojskowych lub ich kronikarzy, w tym uczestników kampanii wojennych Aleksandra Macedońskiego. I, oczywiście, dokumentów sporządzonych przez pokolenia logików, filozofów, matematyków, czyli myslicieli , którzy reprezentowali najbardziej różnorodne szkoły i koncepcje.

Dla niniejszego opowiadania istotne jest to, że Eratostenes zmierzył obwód i średnicę Ziemi z dokładnością różniącą się o mniej niż pięć procent od współczesnych pomiarów satelitarnych tych wielkości. Jest to wynik zadziwiająco dokładny, a możliwy był do uzyskania dzięki zastosowaniu poprawnej metody wykorzystującej stałe relacje geometryczne. Eratostenes ekstrapolował dane uzyskane metodą triangulacji zastosowanej lokalnie na rozmiar całej Ziemi. A oto jakiego rodzaju oprzyrządowanie miał do swojej dyspozycji: długość cienia rzucanego przez pręt w Aleksandrii oraz długość takiego cienia na dnie wyschniętej studni w Syene (dzisiejszy Asuan), w momencie gdy Słońce znajduje się w zenicie.

Eratostenes przyjął do swoich wyliczeń, iż obie miejscowości, które znajdują się w Egipcie, położone są na tej samej długości geograficznej. Nie jest tak dokładnie, ale odchylenie jest niezbyt znaczne i wynosi około 2,5 stopnia. Badacz przyjął poprawne założenie, że gdyby Ziemia była płaska, wówczas długość cienia rzucanego przez pręty o tej samej porze dnia, zarówno w Aleksandrii jak i w Asuanie, byłaby jednakowa. Rzecz jasna, długość rzucanego cienia była różna. Z otrzymanej różnicy wyprowadził kąt krzywizny Ziemi, znając zaś dystans dzielący od Syene do Aleksandrii (w linii prostej ok. 800 km) mógł obliczyć pełny obwód ziemski, a następnie promień planetarny. Przykład Eratostenesa wskazuje, że najważniejszy jest pomysł, czyli znalezienie właściwej metody pozwalającej wykorzystać dane, które są dostępne. Wielu ludzi angażowało się w poszukiwanie najbardziej adekwatnej metody dla zmierzenia tego, czego nie dawało się pomierzyć bezpośrednio, a nawet przy braku właściwego punktem odniesienia. Ludzi takich określamy mianem naukowców.

Niemal wszyscy wiedzą, iż koncepcję heliocentryczną wprowadził do obrazu świata Mikołaj Kopernik, ale już daleko nie wszyscy, że znacznie wcześniej, bo w III wieku a.Ch.n., czyli 17 wieków przed kanonikiem z katedry we Fromborku, taki model wszechświata zaproponował Arystarch z Samos.

(320 – 250 a.Ch.n., astronom grecki urodzony na wyspie Samos; pracujący w Aleksandrii. Daty jego urodzin i śmierci są podawane z dokładnością plus minus 10 lat. Zaproponował heliocentryczny model układu planetarnego oraz poprawnie oszacował odległość od Ziemi do Księżyca i błędnie odległość od Ziemi do Słońca).

Arystarch, korzystając z wielkości kątowych cienia Ziemi podczas zaćmienia Księżyca, oszacował średnicę naturalnego satelity Ziemi oraz doń odległość. Uwzględniając poziom i rodzaj przyrządów technicznego, którymi mógł dysponować dla określenia rozmiarów kątowych Księżyca i Ziemi oraz możliwej do uzyskania dokładności w obliczeniach wysokości kątowej „środka” Księżyca nad horyzontem, osiągnął więcej niż poprawny wynik, bliski współczesnym danym, uzyskiwanym przy wykorzystaniu teleskopów, satelitów oraz zaawansowanej techniki laserowej. Czyli w tamtym czasie nikt nie zdołałby wykonać bardziej dokładnych obliczeń. Niestety, publikacje Arystarcha prawie w całości spłonęły wraz ze zbiorami Biblioteki Aleksandryjskiej, czyli zostały na bardzo długi czas zapomniane. Problem w tym, że należały one do koncepcji typu filozoficznego i nie mogły być podstawą wyliczeń pozycji planet w poszczególnych momentach roku. Oznacza to, iż koncepcja Arystarcha, w przeciwieństwie do koncepcji Kopernika, była ideą bez możliwości jej zastosowania w praktyce.

A właśnie model kopernikański umożliwiał tego rodzaju obliczenia. Ponadto propozycja Kopernika związana była z pilną potrzebą uproszczenia rachuby coraz dalej idących korekt wynikających z rosnącego niedopasowania modelu geocentrycznego do realnie obserwowanych pozycji planet. W modelu kopernikańskim nastąpiła zamiana punktu odniesienia dla obliczania pozycji obserwatora (z Ziemi na Słońce), co zdecydowanie uprościło życie np. kapitanom statków morskich. Od codziennego ustalania pozycji na morzu poprzez określanie wysokości Słońca nad horyzontem bardzo wielu z nich traciło dosyć szybko wzrok w jednym oku, a wcale nie w wyniku starć z piratami).

Kryterium funkcjonalności powodowało, że model kopernikański znalazł zastosowanie praktyczne, bez względu na to, czy poprawnie odwzorowywał on rzeczywistość. Tak zasadnicza zmiana w postrzeganiu usytuowania Ziemi i miejsca człowieka we wszechświecie nie mogła odbyć się szybko i bez problemów. I mimo iż model Kopernika miał już zastosowanie w praktyce, to wciąż paradygmatem decydującym o obrazie świata, aż do epoki lunet i teleskopów, były idealistyczne założenia Platona, Eudoksosa i Arystotelesa, oraz jako ich konsekwencja, skonstruowany przez Ptolemeusza geocentryczny model świata z jego centralnym miejscem – Ziemią.

(Eudoksos z Knidos, ok. 408 – 355 a.Ch.n., astronom, matematyk, filozof, geograf. Twórca koncepcji sfer dla wyjaśnienia ruchu Ziemi, Słońca, Księżyca oraz pięciu ówcześnie znanych planet)

Przez bardzo długie wieki uczeni zajmujący się astronomią nie byli w stanie wyobrazić sobie, iż gwiazdy są tak bardzo odległe od Słońca. Z tego względu decydującym argumentem za tym, iż to Ziemia, a nie Słońce stanowi centrum świata, był właśnie fakt, iż nie dawało się zauważyć żadnej zmiany w pozycjach gwiazd. Starożytni matematycy i astronomowie zdawali sobie sprawę, że gdyby Ziemia obiegała Słońce, wówczas musiałaby następować zmiana pozycji gwiazd przy ich obserwowaniu z różnych miejsc ziemskiej orbity wokółsłonecznej w przeciągu roku kalendarzowego. A skoro takich zmian nie dawało się zaobserwować, wysuwali oczywisty wniosek, że Ziemia „nie porusza się”. Zakładali, że gdyby Ziemia odbywała wokółsłoneczny pasaż, musieliby dostrzec zmianę miejsca gwiazd na niebie i zmierzyć dla nich ich kąt paralaksy .

(paralaksa – w astronomii oznacza pozorną zmianę miejsca obserwowanego obiektu na niebie względem innych obiektów, związaną ze zmianą miejsca przez obserwatora; zob. Appendix pkt 2).

Metoda i rozumowanie starożytnych było prawidłowe, ale nie dysponowali wystarczająco zaawansowanymi instrumentami do zaobserwowania i zmierzenia takiego efektu z uwagi na faktyczny dystans do gwiazd, a co zatem idzie, niemierzalną w ich epoce wielkość paralaksy. Z tego właśnie powodu odrzucali model heliocentryczny, jako nie mający potwierdzenia logicznego jak i obserwacyjnego. Jak z tego wynika, nazwa „sfera gwiazd stałych” była do epoki teleskopów w pełni uzasadniona.

W modelu Ptolemeusza odległość do sfery gwiazd stałych (po przeliczeniu greckich stadiów/stadionów na kilometry) wynosiła ok. 80 milionów km, gdy w rzeczywistości odległość do najbliższej gwiazdy (widocznej gołym okiem) wynosi ok. 42 bilionów km. Czyli niedoszacowanie w modelu geocentrycznym wynosiło ponad pół miliona razy. Z kolei w modelu kopernikańskim, aby zachować założenie jego spójności, odległość z modelu ptolemejskiego musiała zostać powiększona do ok. 300 miliardów km, ale i wówczas, błąd oszacowania (odniesiony do dystansu od najbliższej z dostrzegalnych gwiazd) wynosił nadal ok. 130 razy. Należy zastrzec, iż rozmaici autorzy podawali rozmaite wielkości oszacowań dla takich odległości. Ja podaję wersję autorstwa XVII-to wiecznego astronoma -zakonnika Giovanni Battisty Ricciolli’ego SJ, który choć był przeciwnikiem teorii kopernikańskiej, to w zakresie dokładności pomiarów nie miał ówcześnie konkurencji.

Warto sobie uzmysłowić, iż 50 lat po śmierci Kopernika, czyli na początku XVII wieku, żyło w Europie zaledwie 10 uczonych, którzy przyjmowali jego model jako bardziej poprawny od geocentrycznego. I chociaż zaobserwowanie pojawienia się na nieboskłonie nieznanej dotychczas, nowej gwiazdy przez Tychona Brahe w AD 1572 oraz w następnych latach kilku komet, utworzyło rysę na idealnym świecie sfer arystotelesowskich, to konsekwencje tego mogły być dyskutowane wyłącznie w nielicznym światku astronomów.

(Tyge Ottesen Brahe; 1546-1601, astronom duński. Autor zmodyfikowanej koncepcji geocentrycznej)

Do faktycznego przełomu w dziedzinie obrazu kosmosu trzeba było zaczekać aż do początków epoki oka uzbrojonego, czyli do wiosny AD 1610 i Galileusza, który korzystając z lunety o kilkukrotnym powiększeniu, ujrzał cztery księżyce Jowisza. Już kilka lat później zaczęto używać pierwszych lunet o kilkudziesięciokrotnym powiększeniu, a w latach 30-tych XVII stulecia pojawiły się pierwsze teleskopy astronomiczne. W końcu XVII wieku były już w użyciu teleskopy o długości tuby dochodzącej do 10 stóp.

(stopa – ang. foot ; współcześnie jednostka miary o dł. 30,48 cm. Dawniej w różnych krajach jej długość wahała się w granicach 30 cm (plus minus 2 cm).

U progu epoki teleskopów rozpoznanie poprawnych odległości do ciał niebieskich i ich wielkości dotyczyło tylko Ziemi i Księżyca. Prawa Keplera poprawnie oddawały mechanikę nieba i wokółsłonecznego ruchu planet Układu Słonecznego, ale można było z nich wyprowadzić tylko względne odległości dla planet, a ich wszystkich od Słońca. Czyli, korzystając z proporcji keplerowskich można było ustalić, iż planeta A jest najbliżej Słońca, a planeta B jest trzy razy dalej niż planeta A.

Ale nie wiedziano jak zmierzyć, ile wynosi w km odległość planety A od Słońca, a w konsekwencji odległości do innych planet. Oznaczało to, że nie istniał jeszcze sposób, który pozwalałby na określenie, jak duże są to obiekty i jak daleko się one znajdują. Na podstawie pewnych pośrednich wnioskowań, opartych na rozmiarach cienia Ziemi podczas zaćmień Księżyca, próbowano oszacować rozmiary i odległość do Słońca, ale nie dysponowano danymi pozwalającymi na stwierdzenie ich poprawności. W jeszcze większym stopniu niepewność taka odnosiła się do rozmiarów i odległości poszczególnych planet. Dopiero wykorzystanie do obserwacji teleskopów, najpierw soczewkowych (refrakcyjnych), a później także zwierciadłowych, spowodowało iż wszystkie problemy, dotychczas nierozwiązywalne, zostały rozstrzygnięte w dosyć szybkim tempie, czyli można było obliczyć odległości i wielkości głównych obiektów w Układzie Słonecznym.

Walnie przyczynił się do tego pierwszy dyrektor obserwatorium paryskiego. Gdy na arenie technicznych osiągnięć cywilizacji pojawiły się teleskopy, od razu zaczęły odgrywać decydującą rolę w badaniach nieba. Jak wiadomo, są to urządzenia duże oraz drogie i w zasadzie takie były zawsze. W drugiej połowie XVII wieku na zakup sporego teleskopu o długości tuby wynoszącej kilkadziesiąt stóp, stać było jedynie bogatych monarchów, a do takich należał bez wątpienia król Francji Ludwik XIV. Królewskie Obserwatorium w Paryżu wyposażył w kilka tych dużych instrumentów i był bardzo zainteresowany badaniami Słońca, gdyż monarcha ten eksponował przecież publicznie swój wizerunek jako Król-Słońce. Ten rodzaj public relation stanowił istotny powód, iż ów król nie żałował grosza na badania w dziedzinie astronomii. W nowo wybudowanej placówce król zatrudnił od 1671 r. na stanowisku dyrektora tej placówki Giovanni Domenico Cassiniego, który specjalizował się, między innymi, w budowie zegarów słonecznych. Król swoją pierwszą propozycję objęcia dyrektorowania w obserwatorium paryskim skierował do gdańskiego astronoma Jana Heweliusza, który jej nie przyjął.

(Giovanni Domenico Cassini; 1625-1712; włoski matematyk i astronom, dyrektor obserwatorium paryskiego w latach 1671-1712; odkrył cztery księżyce Saturna, pierścienie Saturna oraz zmierzył odległość od Ziemi do Marsa)

Cassini postanowił spróbować zmierzyć paralaksę Marsa i wówczas wyliczyć odległość do tej planety, wykorzystując nadarzającą się okazję, gdy latem AD 1672 planeta ta znajdzie się najbliżej Ziemi, a następnie odległość do Słońca, korzystając ze stosowanych w triangulacji prostych reguł trygonometrii. W tym celu należało wykonać jednoczesny pomiar kąta pod którym widać Marsa z dwóch odległych od siebie miejsc na Ziemi. Jednym z nich było paryskie obserwatorium, drugim zaś faktorie handlowe w Cayenne (Gujana Francuska), dokąd udał się drogą morską Jean Richer, współpracownik Cassiniego. Odległość pomiędzy Paryżem a Cayenne była podstawą trójkąta, którego wierzchołek stanowiła planeta Mars. Po wielu perypetiach, związanych z interpretacją danych, Cassini w AD 1673 ogłosił, iż odległość do Słońca wynosi 140 milionów km (wg współczesnych pomiarów wynosi ona 149,5 mln km). Czyli była to odległość 43 razy większa, niż przyjmowana w modelu kopernikańskim.

Astronomowie ówcześni zdawali sobie sprawę, że dokładność obliczeń przy zastosowanych metodach pomiaru może wzbudzać wątpliwości, toteż starali się potwierdzić lub zanegować osiągnięty wynik, ale otrzymywali rezultaty podobne do podanych przez Cassiniego. Rozmiar świata (tego najbliższego) bardzo wówczas wyogromniał, a co więcej, nie były to już tylko mocno niepewne szacunki odnośnie istniejących odległości. Chociaż nadal nie dało się liczyć bardzo dokładnie (precyzja przyrządów pomiarowych jeszcze tego nie umożliwiała), ale nie były to wielkości zupełnie dowolne i mniej czy bardziej wyimaginowane.

Jeszcze o jednym pomiarze warto wspomnieć, który będzie pełnić ważną rolę w dalszej części tej opowieści. Mniej więcej w tym samym czasie (AD 1676) duński astronom Olaf Roemer (1644-1710), jako pierwszy pomierzył prędkość światła i uzyskał wynik w granicach 75% aktualnej wielkości. Otóż zauważył on, iż czas zniknięcia księżyców Jowisza za tarczą tej planety zmienia się zależnie od odległości Jowisza od Ziemi. Założył, iż pozorne opóźnienie obrazu zaćmień wynika z prędkości światła docierającego do obiektywu teleskopu. Im Jowisz znajduje się dalej od Ziemi, tym większe jest takie opóźnienie. Otrzymał wynik wynoszący 225 000 km/sek., podczas gdy wg pomiarów współczesnych, uzyskanych z wykorzystaniem zegarów atomowych, promieni lasera, teleskopów kosmicznych i misji satelitarnych, prędkość światła w próżni została określona na 299 792 km/sek. Rezultat uzyskany przez Roemera był niezbyt dokładny, ale tylko taki stopień precyzji można było osiągnąć, przy zastosowaniu dostępnych wówczas urządzeń. Tak więc na początku XVIII wieku astronomowie znali odległość tylko do jednej gwiazdy, tj. do Słońca.

Podejmowane próby obliczenia paralaksy dla innych gwiazd, przy wykorzystaniu ówczesnych przyrządów nie dawały rezultatu, dlatego poszukiwano innego sposobu, który mógłby być użyteczny do tego celu. Skorzystano z pomysłu Izaaka Newtona, gdyż on odkrył zasadę, która mogła zastąpić nieefektywne pomiary paralaksy. Zasadą taką była zależność, iż jasność źródła światła zmienia się zgodnie z „prawem odwrotności kwadratu”. Ilustruje to sytuacja, w której umieszczamy dwie świecące żarówki 100-watowe w jednakowej odległości od obserwatora, a następnie jedną z nich przeniesiemy na odległość dwa razy większą. Jasność obserwowana żarówki przeniesionej będzie 4 razy mniejsza niż żarówki, która została na poprzednim miejscu. Zasada ma również zastosowanie w sytuacji odwrotnej, czyli jeśli wiemy, że gdzieś świecą żarówki o tej samej mocy i zmierzymy odległość do jednej z nich (nasze Słońce), zaś z pomiaru jasności innej żarówki (gwiazdy) wyniknie, iż świeci ona 4 razy słabiej, to oznacza, że znajduje się ona dwukrotnie dalej, niż żarówka (gwiazda) do której znamy odległość. Ta zasada dawałaby poprawne wyniki, gdyby wszystkie żarówki (gwiazdy), które świecą z taką samą mocą, miały takie same rozmiary i na dodatek nie poruszały się. Z punktu dzisiejszego stanu wiedzy założenia takie były kompletnie niezgodne z rzeczywistością. Ale wówczas, z braku jakichkolwiek danych w tym względzie, początkowo przyjęto ten sposób.

Od momentu „podpowiedzi” udzielonej przez Newtona, astronomowie nie byli już skazani na korzystanie tylko z jednej metody opartej na pomiarach paralaksy. W latach 20-tych XVIII wieku angielski astronom Edmund Halley (ten od znanej komety) porównał zapisy o pozycjach gwiazd, znajdujące się w pismach Ptolemeusza, ze zmierzonymi przez siebie pozycjami tych samych gwiazd. Okazało się, że dla kilku gwiazd odchylenie było na tyle istotne, iż wskazywało na istnienie ich ruchu własnego. Wielkość odchylenia nie mogła być wyjaśniona brakiem precyzji zapisów dokonanych w starożytności, gdyż dla pozostałych przypadków zapisy odnoszące się do ich pozycji nie wskazywały na istnienie odchyleń. Dlaczego zatem naniesienie pozycji akurat dla tych kilku miałoby okazać się niepoprawne? W ten sposób, z mrowia gwiazd na niebie, można było wytypować te, dla których warto było spróbować wyliczyć wielkość paralaksy. Halley spróbował, ale nie dał rady wyliczyć. Przyrządy, którymi dysponował, miały wciąż zbyt małą rozdzielczość.

Pierwsze poprawne pomiary paralaksy dla trzech gwiazd wykonane zostały dopiero w latach 1839-1840, czyli już w epoce zaawansowanych teleskopów i precyzyjnych siatek mikrometrycznych (siatka zakładana na okular teleskopu). Siatki te pozwalały na dokładne oznaczanie pozycji gwiazd na nieboskłonie, czyli dla astronomów stanowiły niezbędne oprzyrządowanie, bez którego wcześniej nie było możliwości wykonywania pomiarów z wystarczającą dokładnością. Poprawne pomiary paralaksy musiały ponadto uwzględnić i skorygować efekty wahania w ruchu Ziemi wokół Słońca (tzw. aberracja, którą wykrył angielski astronom James Bradley) oraz zakłócenia w ruchu Ziemi wokół własnej osi spowodowane tym, że Ziemia nie ma idealnie sferycznego kształtu (efekt nutacji). Okazało się, że wielkość zmierzonych paralaks stanowi ułamek sekundy kątowej, co oznaczało, że gwiazdy te, jakkolwiek relatywnie bliskie Słońcu, dzieli od nas niewyobrażalnie daleki dystans.

(wielkość kątowa; koło dzieli się na 360 stopni, stopień odpowiednio o 60 minut, minuta 60 sekund, co oznacza , iż pełne koło zawiera 1.296.000 sekund kątowych)

Gdy astronomowie poznali odległości do kilku gwiazd, mogli wyliczyć wielkość ich jasności absolutnej. Z obliczeń wynikło, że każda z nich świeci z inną mocą, wobec czego zasada podana przez Newtona nie może być powszechnie stosowana. Można byłoby ją zastosować jedynie w przypadku do jednorodnych grup gwiazd. Ale jaki parametr byłby charakterystyczny dla oceny stopnia jednorodności? Okazało się, że istnieje taka cecha.

Wskazał ją w początkach XIX wieku, bawarski chemik, optyk i konstruktor Joseph von Fraunhofer. Były to linie widmowe, które obserwowane są w widmie każdego gorącego ciała, gdy światło pochodzące od tego ciała rozdzielimy na pryzmacie. Gdy ciało, które jest rozżarzone, otacza atmosfera chłodniejszego gazu, wówczas gaz absorbuje w obrazie widma te kolory, które emitowałby sam, gdyby był rozgrzany do tej samej temperatury. W przypadku różnicy temperatur na obrazie widma występują ciemne prążki. Porównując rozkład prążków dla konkretnego widma, można stwierdzić jaki gaz (lub gazy) składają się na atmosferę np. gwiazdy. Każdy gaz absorbuje ściśle określone, swoiste częstotliwości widma, coś jakby odcisk linii papilarnych danego obiektu (w naszym przypadku gwiazdy). A ponadto bez względu na to jak daleko się on znajduje, pod warunkiem, iż uzyskana jakość widma pozwoli na rozróżnienie w nim takich linii.

(Joseph von Fraunhofer ;1787-1826; fizyk i astronom bawarski, pierwszy zmierzył heliocentryczną paralaksę Słońca).

Można przyjąć, iż astronomia obserwacyjna przekształciła się wraz z wykorzystaniem, poza matematyką, także fizyki i chemii, w zaawansowaną naukę od momentu wyjaśnienia w pierwszej połowie XIX wieku przez austriackiego fizyka Christiana Dopplera przesunięć linii absorpcyjnych w widmach gwiazd. Doppler wykazał, iż ruch źródła światła w kierunku do obserwatora powoduje przesunięcie w stronę fioletowego koloru widma, zaś ruch od obserwatora przesunięcie w stronę czerwonego koloru widma. A gdy w XIX w. do badań kosmosu dołączyło się jeszcze wykorzystanie kolejnego wynalazku, jakim była fotografia, mogła na dobre rozpocząć się epoka astrofizyki.

Na progu XX wieku, astronomowie znali w przybliżeniu odległości zaledwie do kilkunastu gwiazd bliskich Słońcu, a możliwy do osiągnięcia stopień rozdzielczości w pomiarze paralaksy pozwalał na określanie odległości maksymalnie do 100 lat świetlnych, z marginesem błędu zwiększającym się wraz z mierzoną odległością. Pomiary dotyczące odległości obiektów bardziej oddalonych były bardzo niedokładne. I nadal nie znano odpowiedzi na pytanie, czy nasz Układ Słoneczny stanowi część struktury, będącej całym wszechświatem, ani też jak duże posiada ona rozmiary.

W tekście często używany jest termin paralaksa. Jednak co takiego on oznacza w przystępnym wyjaśnieniu. Otóż pewnie każdy próbował patrzeć na jakiś przedmiot zakrywając raz prawe, a raz lewe oko. Jeśli ten przedmiot stał np. na półce znajdującej się w pewnej odległości od nas, a jeszcze na tej samej półce znajdował się obok np. wazon, wówczas patrząc na przedmiot, przy zmianie oka, widzielibyśmy go w innej odległości od wazonu. Wielkość różnicy tej odległości mierzonej od punktu odniesienia, czyli wazonu i miejscem, z którego patrzymy (w tym przypadku byłoby to miejsce danego oka), utworzy kąt określany jako paralaksa. W przypadku planet lub bliskich gwiazd, jednym takim okiem może być miejsce obserwacji położone na jednym kontynencie, drugim zaś na innym kontynencie. Mówimy wówczas o paralaksie geocentrycznej, mierzonej z miejsc znajdujących się na powierzchni Ziemi. Natomiast w przypadku gwiazd naszymi oczami będą odpowiednio te miejsca obserwacji, gdy Ziemia znajduje się na orbicie wokół Słońca w konkretnej dacie oraz w dacie o sześć miesięcy późniejszej (Ziemia będzie wówczas dokładnie po przeciwnej stronie Słońca). Taki pomiar określamy jako paralaksę heliocentryczną, gdyż w takim przypadku rozstaw „oczu” stanowi rozmiar średnicy wokółsłonecznej orbity Ziemi. Jeśli we wskazanych datach określimy położenie interesującej nas gwiazdy i zmierzymy różnicę jej odległości od punktu odniesienia (zazwyczaj będzie to pobliska jasna gwiazda), otrzymamy wielkość kątową pozornej zmiany miejsca gwiazdy, którą nazywamy paralaksą. Znając podstawę trójkąta, czyli średnicę orbity Ziemi oraz kąt pod jakim nachylone są dwa boki tego trójkąta, wówczas łatwo wyliczymy odległość do gwiazdy, korzystając z reguł trygonometrii. Precyzja takich pomiarów jest ściśle uzależniona od jakości, czyli rozdzielczości oprzyrządowania technicznego, którym dysponujemy oraz ścisłej synchronizacji w czasie momentu ich dokonywania.

Dla porównania podam, iż rozdzielczość oka nieuzbrojonego osoby obdarzonej normalnym wzrokiem wynosi ok. jednej trzydziestej stopnia, czyli dwóch minut kątowych. Odpowiada to możliwości rozróżnienia i odczytania liter o wysokości 3 milimetrów z odległości pół metra. A np. planeta Wenus, która dla obserwatora z Ziemi ma największą średnicę kątową swojej tarczy (poza Słońcem i Księżycem), posiada paralaksę o wielkości około pół minuty. Oznacza to, iż bez pomocy przyrządów optycznych wszystkie obiekty na niebie, poza Słońcem i Księżycem, postrzegamy tylko jako świecące punkty różniące się jasnością obserwowaną, ale nie zdołamy dostrzec ich rozmiarów kątowych, czyli rozmiaru tarczy tych ciał niebieskich. Ale dla pomiaru paralaksy bardziej odległych gwiazd także wielkość średnicy orbity ziemskiej nie była wystarczająca.

Ponownie pomocna okazała się właściwa metoda w osiągnięciu kolejnego etapu w mierzeniu odległości do poza słonecznych światów. Nieco wcześniej wspomniałem o zjawisku Dopplera, które wskazuje na to, czy poruszający się względem obserwatora obiekt, oddala się od niego bądź przybliża. Widmo obiektu będącego w ruchu jest przesunięte w relacji do widma – wzorca dla obiektu nieruchomego. Czyli dla ziemskich obserwatorów to Słońce byłoby obiektem pozostającym w bezruchu, zaś inne gwiazdy wykazywałyby ruch własny. Gdy porównamy widmo jakiegoś pierwiastka występującego w atmosferze gwiazdy (np. sodu), kierunek przesunięcia w widmie w stosunku do widma-wzorca (widma słonecznego, albo widma otrzymanego w ziemskim laboratorium, jako wyniku spalania np. sodu), wskazałby nam, czy interesująca nas gwiazda przybliża się czy oddala względem obserwatora znajdującego się w pobliżu Słońca. Ponadto dałoby się określić szybkość takiego ruchu np. w kilometrach na sekundę.

Ale w praktyce nie występuje ruch gwiazd po obserwacyjnej linii prostej, gdyż wszystkie poruszają się względem Słońca pod różnymi kątami. Z tego powodu należało znaleźć jakiś sposób pozwalający na obliczenie, ile z tego ruchu przypada na właściwy kierunek. Pomiar możliwy do przeprowadzenia mógł dotyczyć wyłącznie dwóch parametrów, tj. przesunięcia widma oraz zmiany położenia gwiazdy na niebie, która jest wielkością wyrażaną w miarach kątowych. Bez znajomości odległości do gwiazdy nie można przeliczyć jej ruchu, wyrażonego w jednostkach względnych (kątowych), na prędkość tego ruchu w km/sek. Tak więc problemem do rozstrzygnięcia pozostawało ustalenie odległości do gwiazdy w jednostkach miar bezwzględnych. Przyjęto założenie (słuszne), że gwiazdy w gromadzie poruszają się w spójny sposób po trajektoriach do siebie równoległych albo prawie równoległych. Efekt perspektywy powoduje, że gdy gromada gwiezdna w swoim ruchu przybliża się do Słońca, to jej wielkość rośnie, a gromada jakby puchnie, bowiem trajektorie gwiazd, niczym szyny kolejowe, rozbiegają się od siebie. Gdy oddala się od Słońca, efektem obserwacyjnym jest zbieganie się poszczególnych trajektorii w jeden punkt.

Jednak w przypadku pojedynczej gwiazdy efekt ten jest znacznie trudniejszy do zmierzenia. Oznaczenie punktu (teoretycznego środka gromady), w którym trajektorie gwiazd zbiegają się, pozwalało określić, jakie jest odchylenie uśrednionej trajektorii ruchu gromady od linii obserwacyjnej. Z kolei poznanie wielkości kątowej tego odchylenia umożliwiało obliczenie, jaka część rzeczywistej prędkości gwiazd przypada na ruch poprzeczny, a jaka na ruch wzdłuż kierunku obserwacji. Natomiast sumaryczną prędkość ruchu gwiazdy poznano z przesunięcia widma. Pozostawała wówczas do rozwiązania dosyć prosta rachunkowa zależność, a mianowicie jak daleko musi znajdować się taka gromada gwiazd, aby znana już, poprzeczna składowa jej prędkości, dała w ciągu roku efekt przesunięcia o tyle a tyle sekund kątowych (lub części takiej sekundy). Zob. Appendix pkt 3.

Zasadniczy przełom w astronomii XX wieku przyniosło szersze zastosowanie techniki fotograficznej i utrwalanie obrazów z teleskopu na światłoczułej kliszy. Można było na tej podstawie dokładnie pozycjonować poszczególne obiekty, porównywać ich położenie oraz zmiany jasności w okresach czasu określonych przez badaczy. Rozwinięcie techniki długotrwałych ekspozycji (naświetleń) pozwalało również na dostrzeżenie szczegółów w inny sposób niemożliwych do zauważenia. Na początku XX wieku Harvard College Observatory (Mass., USA) miało placówką obserwacyjną w peruwiańskim mieście Arequipa (Southern Observatory). Z tego obserwatorium przywieziono do Obserwatorium w Harvardzie zdjęcia południowego nieba, którego obiekty nie są widoczne z półkuli północnej. Pośród tych zdjęć znajdowały się fotografie Obłoków Magellana (zob. Appendix pkt 4). Astronomowie byli zgodni co do tego, że te Obłoki stanowią skupiska gwiazd, ale nie było pewności co do ich położenia względem Drogi Mlecznej. Powstały różnice zdań co do tego, czy są one częścią naszej Galaktyki, czy też stanowią względem niej odrębną morfologicznie strukturę.

Analizę zdjęć przeprowadziła kobieta-astronom Henrietta S. Leavitt, która wyodrębniła w AD 1907 ok. 2 tys. gwiazd zmiennych, znajdujących się na zdjęciach Obłoków Magellana. Po dwuletniej obróbce danych opublikowała listę ok. 1000 gwiazd zmiennych z Małego Obłoku oraz ok. 800 gwiazd z Dużego Obłoku. Wstępnie wyniki analizy dotyczyły 16 gwiazd, dla których określiła systematyczne okresy pulsacji, po czym powiązała je z jasnością gwiazd wg zależności, iż dłuższy okres pulsacji mają gwiazdy jaśniejsze.

(Henrietta Swan Leavitt (1862 – 1921), amerykański astronom pracujący w Harvard College Observatory w zespole Edwarda Pickeringa).

W AD 1912 H. Leavitt opublikowała dane dla kolejnych 25 gwiazd z Małego Obłoku z ustaloną zależnością okres – jasność. Rodzajem gwiazd o zmiennej jasności były cefeidy, nazwane tak od gwiazdy Delta Cephei (zob. Appendix pkt.5), dla której okres zmienności poznano już pod koniec XVIII wieku i której charakterystyka odpowiadała parametrom cech badanych gwiazd z Obłoku Magellana. Tym samym, H. Leavitt udowodniła zależność, iż cefeidy o podobnej jasności absolutnej posiadają podobny okres zmienności. I jeśli poznamy stosunek zmienności dwóch cefeid, to jednocześnie poznamy dla nich relację jasności. Czyli jeśli gdzieś na niebie odkryjemy gwiazdę typu cefeida i zmierzymy jej okres zmienności, wówczas można dokonać oceny, jaką miałaby jasność, gdyby znajdowała się pośród gwiazd Małego Obłoku Magellana.

Zależność okres – jasność mógł zostać wykorzystany do wyznaczania odległości nie tylko w ramach Drogi Mlecznej, ale ze względu na jasność cefeid, także w odniesieniu do pobliskich galaktyk, w których mogła być zmierzona taka zależność dla znajdujących się tam cefeid. Wyniki pracy H. Leavitt stanowiły podstawę do wykonania nie tyle kroku milowego, co skoku “siedmiomilowego”, jeśli chodzi o dotychczasowe możliwości metod pomiaru odległości międzygwiezdnych. W wyniku odkrycia dokonanego przez H. Leavitt, cefeidy zaczęły pełnić rolę tzw. świec standardowych (zob. Appendix pkt 6), wykorzystywanych do kalibracji odległości dla innych typów gwiazd i obiektów kosmicznych. H. Leavitt zmarła na raka w wieku 53 lat, i nie zdążyła zostać uhonorowana nagrodą Nobla, chociaż w pełni na nią zasługiwała. Niestety, kalibracja faktycznych odległości za pomocą cefeid nie mogła być zrealizowana w czasach odkrycia dokonanego przez H. Leavitt, gdyż nie było jeszcze możliwe zmierzenie odległości do żadnej ze znanych ówcześnie cefeid (zobacz: Appendix pkt 7) i, tym samym, nie można było obliczyć wartości dla ich jasności absolutnych. Nie znano także odległości do Obłoków Magellana. Tak więc zależności dotyczące odległości cefeid od Słońca mogły być tylko względne, czyli określały ile razy dalej lub bliżej są badane gwiazdy względem siebie. Ale H. Leavitt wytyczyła szlak, którym inni doszli dalej.

Jednym z tych pionierów, którzy postawili kolejny kamień milowy był Harlow Shapley, który od AD 1914 pracował przy największych ówczesnych teleskopach zwierciadłowych na Ziemi, których lustra miały średnicę najpierw 60, a od 1917 r. już 100 cali.Tym miejscem było Mt. Wilson Observatory w pobliżu miejscowości Pasadena w Kalifornii.

(Harlow Shapley; 1885-1972; doktorat z fizyki uzyskał na Uniwersytecie w Princeton, amerykański astronom, dyrektor Harvard College Observatory w latach 1921-1952, poprzednio, w latach 1914-1921, kierownik w Mt. Wilson Observatory).

Shapley wpadł na pomysł najprostszy z możliwych. Znana była już przecież dokładna odległość przynajmniej do jednej gwiazdy, czyli do Słońca, a tym samym również wartość jego jasności absolutnej. Postanowił porównywać jasności cefeid do jasności Słońca i powyliczać dla nich jasność absolutną. Okazało się, iż cefeidy należą do kategorii najjaśniejszych gwiazd na niebie. Mając do dyspozycji nowoczesny i duży teleskop, H. Shapley zaczął poszukania bogatych źródeł cefeid. Zaobserwował, że najwięcej tych gwiazd znajduje się w gromadach kulistych. Był zatem przekonany, że po wytypowaniu gromad, w których cefeidy będą pełniły rolę świec standardowych, stanie się możliwe wyliczenie do nich odległości. Problem okazał się znacznie bardziej skomplikowany, gdyż dobrze określone okresy jasności cefeid udało mu się zmierzyć tylko dla trzech gromad, kilka innych pomiarów przeprowadził za pomocą innych gwiazd zmiennych, świecących trochę słabiej od cefeid, czyli gwiazd typu RR Lyrae (zob. Appendix pkt 8).

Dla pozostałych wykonał szacowanie odległości na podstawie arbitralnie określonych założeń, np. że najjaśniejsze gwiazdy w takich gromadach (bez względu na typ tych gwiazd) mają zbliżoną jasność absolutną. A w stosunku do najsłabiej widocznych gromad przyjął założenie, że każda z gromad kulistych ma podobne rozmiary absolutne. Porównując wielkości kątowe takich gromad do rozmiarów kątowych gromad dla których udało mu się zmierzyć odległość, oszacował dystans dzielący je od Słońca. Łącznie na 69 gromad, co do których założył,

iż wyznaczają rozmiary Drogi Mlecznej, aż do 41 z nich oszacował odległości na podstawie proporcji dla ich rozmiarów kątowych. W AD 1918 opublikował wyniki swoich wyliczeń, z których wynikało, iż Droga Mleczna jest olbrzymią strukturą gwiezdną o średnicy ok. 330.000 lat światła, zaś odległość Słońca od jej centrum wynosi ok. 65.000 lat światła. Oznaczało to, iż wszystkie widoczne przez teleskopy obiekty powinny mieścić się w ramach tej rozległej struktury. Inaczej mówiąc, powinna ona była stanowić cały wszechświat. Wszystkie gromady gwiezdne i mgławice, wliczając w to Wielką Mgławicę w Andromedzie, byłyby wówczas jej fragmentami. (zob. Appendix pkt 9)

Shapley posiadał dowód, że jest inaczej, ale był on z rodzaju tych, co „nie mieszczą się w głowie”. Otóż w AD 1885 pojawiło się widmo w Wielkiej Mgławicy w Andromedzie, które wskazywało, że jeśliby ta mgławica nie znajdowała się w obrębie Drogi Mlecznej, wówczas obserwowane widmo musiałoby należeć do obiektu o jasności ok. miliarda Słońc, czyli świecącego tak mocno, jak cała galaktyka (mała). Morfologia i ewolucja tego rodzaju obiektów nie były wówczas rozumiane. Nie znano natury wybuchów kończących życie masywnych gwiazd, później nazwanych terminem supernowa. Shapley zdawał sobie sprawę z tego, że pomiary na granicy rozdzielczości oraz odgórnie przyjęte założenia dla oszacowania odległości, muszą być obarczone błędem. Nieznana były jednak przyczyny oraz skala błędu. Należy go usprawiedliwić, gdyż ówczesna jakość aparatury fotograficznej i używanych klisz fotograficznych, na których można było uzyskać ekspozycje widm drogą naświetlania, nie może być porównywana z późniejszymi, a zwłaszcza współczesnymi ich parametrami. Niemniej H. Shapley był pierwszym badaczem, który za pomocą poprawnej metody oszacował rozmiar Drogi Mlecznej. Gdyby znany był mu wówczas cykl ewolucyjny poszczególnych typów gwiazd, wówczas zaobserwowanie wybuchu supernowa pozwoliło by mu na przedstawienie znacznie bardziej poprawnego modelu kosmosu.

Upłynęło zaledwie kilka lat, gdy zweryfikowane zostały założenia przyjęte przez Shapley’a. Wykazano, iż jedne z nich były zbyt uproszczone a inne całkiem błędne (zwłaszcza założenie, iż mgławice kuliste mają takie same rozmiary absolutne). Uproszczenia kumulowały się drogą przenoszenie błędu systematycznego, czyli powodowały, że błąd ten powiększał swoje rozmiary w kolejnych stadiach oszacowania. W efekcie został odrzucony obraz wszechświata proponowany przez Shapley’a. Stało się to w dniu 1 stycznia AD 1925 podczas corocznego, noworocznego spotkania w Waszyngtonie członków Amerykańskiego Towarzystwa Astronomicznego, na którym odczytano referat astronoma, który wolał być drugorzędnym astronomem, niż pierwszorzędnym prawnikiem i który dla astronomii zrezygnował z zawodu prawnika (studia prawnicze na Uniwersytecie w Oxfordzie jako stypendysta Fundacji Rhodesa oraz studia z matematyki i astronomii na uniwersytecie w Chicago).

Astronom ten nazywał się Edwin Powell Hubble (1889-1953) i uznawany jest za jednego z najwybitniejszych astronomów XX wieku. Po powrocie z I wojny światowej, gdzie wojował przez parę miesięcy w AD 1917, podjął pracę w obserwatorium na Mt.Wilson w Kalifornii. Niedawno uruchomiono tam 100-calowy teleskop zwierciadlany (a dokładniej o średnicy zwierciadła 94,5 cala). Potem pracował w obserwatorium na górze Palomar (Kalifornia), gdzie w AD 1949 uruchomiono potężny teleskop zwierciadłowy o średnicy 508 cm (zob. Appendix pkt 10). W październiku AD 1923 w obserwatorium Mt. Wilson, E. Hubble wycelował tubę 100-calowego teleskopu w spiralne ramiona Wielkiej Mgławicy w Andromedzie. Po półgodzinnym naświetlaniu, a następnie wywołaniu kliszy z obrazem fragmentu Mgławicy, ujrzał wśród mrowia rozmazanych światełek, wyraźny obraz pojedynczej gwiazdy. Była to cefeida (potem okazało się, że miała jasność 7 000 razy większą od Słońca). Wystarczyło teraz tylko zarejestrować jej okres pulsacji (zmian jasności), aby przypisać jej jasność absolutną. Znając jasność widomą można już było z różnic w jasności widomej i absolutnej łatwo wyliczyć odległość do tej cefeidy, a tym samym do Mgławicy w Andromedzie.

W ciągu następnego roku E. Hubble, wykonując fotografie poszczególnych fragmentów tej Mgławicy, odnajdywał kolejne cefeidy, aby zweryfikować poprawność dokonywanych wyliczeń na większej liczbie przypadków. Pod koniec AD 1924 był prawdopodobnie jedynym człowiekiem na Ziemi, który wiedział, że poza Drogą Mleczną istnieją inne światy oraz że mgławice spiralne to bardzo odległe galaktyki. I że tych galaktyk jest bardzo wiele. W dniu 1 stycznia AD 1925 na wspomnianym posiedzeniu ATA w Waszyngtonie E. Hubble przedstawił wyniki swoich badań.

E. Hubble (przy pomocy Miltona Humasona) oraz Vesto M. Sliphera, który pracował w Obserwatorium Lovella, uzyskali dane wskazujące, że mgławice spiralne poruszają się z bardzo znacznymi prędkościami względem linii obserwacji, na co wskazywały pomiary tych prędkości uzyskane przy pomocy efektu Dopplera (kierunek przesunięcia linii dyfrakcyjnych). V. Slipher już w AD 1914 przedstawił pierwsze wyniki takich pomiarów, ale nikt, w tym także sam Slipher, nie potrafił wówczas zinterpretować takiego efektu.

(Vesto Melvin Slipher – 1875 – 1969, astronom amerykański, pracował w Lovell Observatory. Jako pierwszy wskazał na przesunięcia linii dyfrakcyjnych w widmach mgławic spiralnych (galaktyk) wskazujące na ich znaczna prędkość radialną w kierunku od obserwatora;

Lovell Observatory – założone w 1894 r. w miejscowości Flagstaff w Arizonie (hrabstwo Coconino) przez fundatora Percivala Lovella, multimilionera i „fanatyka” astronomii).

W AD 1929 Hubble i Humason znali przesunięcia widm dla 46 mgławic spiralnych, zaś V. Slipher dla 39, z których prawie wszystkie wskazywały, iż mgławice spiralne oddalają się od Słońca (tj. od naszej galaktyki).

Trudno było znaleźć odpowiedź na pytanie, czy prędkość oddalania się jest skorelowana z odległością. Widmo cefeid było możliwe do zarejestrowania dla najbliższych kilku galaktyk, lecz pozostałe były zbyt odlegle. Znowu pojawił się problem, podobny do tego jaki rozwiązała H. Leavitt, a mianowicie co może stanowić dla takich pomiarów właściwą „świecę standardową”, E. Hubble przyjął (podobnie jak to uczynił Shapley w przypadku gromad kulistych), że najjaśniejsze gwiazdy (niekoniecznie cefeidy) w galaktykach mają zbliżoną wartość jasności absolutnej. Znając odległość do kilku najbliższych galaktyk, zdołał określić na podstawie różnicy jasności widm takich gwiazd, odległości dla 24 galaktyk. Wówczas wyraźna stała się korelacja odległości galaktyk z szybkością ich oddalania się (ucieczki). Wyniki tych badań E. Hubble opublikował w AD 1929 r.

Dla astrofizyków stało się wówczas jasne, że potwierdzona obserwacyjnie ekspansja wszechświata jest naturalną konsekwencją ogólnej teorii względności sformułowanej przez A. Einsteina oraz pasuje do jednego z modeli opartych na niej oraz efektów z nią związanych opisanych przez Wilhelma de Sittera. Koncepcje teoretyczne znalazły swoje potwierdzenie obserwacyjne.

Ale skoro wszechświat się rozszerza, to oznacza, że w przeszłości był mniejszy. Jeśli byśmy puścili taki film wstecz, to musiał zaistnieć jakiś początek, od którego zaczęła się ekspansja. W drodze powyższego wnioskowania pojawiła się koncepcja Big Bangu, czyli Wielkiego Wybuchu, czyli aktualnego kosmologicznego Modelu Standardowego. Otrzymywane w następnych latach wyniki obserwacji i ich interpretacje uszczegółowiały i jednocześnie potwierdzały słuszność zaproponowanego modelu. Jednym z kluczowych potwierdzeń było wyselekcjonowanie z ogromu fal elektromagnetycznych zalewających kosmos, tzw. temperatury promieniowania tła, dokonane w połowie XX wieku przez amerykańskich radioastronomów A. Penziasa i R. Wilsona. Były to najdawniejsze możliwe do wykrycia ślady Big Bangu. E. Hubble oszacował wiek i rozmiar wszechświata (dostępnego obserwacjom) na 10-20 miliardów lat świetlnych. Zmarł w wieku 64 lat i także nie doczekał się nagrody Nobla..

Od tego czasu coraz doskonalsze instrumenty i techniki obliczeniowe, wyniesienie w kosmos teleskopów i wyspecjalizowanych laboratoriów, stosowanie optyki adaptatywnej, zbieranie danych we wszelkich możliwych do rejestracji zakresach widm, doprowadziło do stopniowego zwiększania dokładności w mierzeniu prędkości ucieczki galaktyk, czyli rozszerzania się wszechświata, jak również wszelkich innych danych astrofizycznych. Prędkość ekspansji mierzona jest za pomocą tzw. stałej Hubble’a. Jej wielkość na dzisiaj wskazuje, iż j rozmiar Wszechświata dostępny dla naszej obserwacji wynosi 13,8 mld lat., tylko należy dodać że chodzi o lata świetlne.

Tak wynika z obecnych założeń przyjętych do konstrukcji kosmologicznego Modelu Standardowego. Natomiast pozostaje zagadką, czy w XXI wieku będziemy zmuszeni do zmiany założeń dla obecnego Standardowego Modelu w kosmologii oraz jaki będzie rozmiar Wszechświata wg ewentualnego nowego modelu?

APPENDIX

1.

„Nova” – gwiazda okresowo zmieniająca jasność, zwiększająca ją wielokrotnie wskutek wybuchowego odstrzelenia zewnętrznych warstw atmosfery. Jest to zazwyczaj przypadek ciasnego układu składającego się z normalnej gwiazdy i białego karła (sprasowanego jądra zdegenerowanej gwiazdy), gdzie wskutek oddziaływania grawitacji białego karla następuje ciągły przepływ powierzchniowych składników atmosfery gwiazdy (akrecja) do białego karła. Układ taki nazywa many jest kataklizmicznym. Powyżej pewnej gęstości progowej następuje wybuch tych warstw i obserwujemy na niebie niewidoczną dotychczas gwiazdę, gdyż jasność jej może wówczas wzrosnąć od 100 do 1000 razy. Mechanizm ten powtarza się albo do momentu rozerwania białego karła (supernowa), albo do ustania mechanizmu akrecji powierzchniowych warstw atmosfery z normalnej gwiazdy (warstwy głębiej położone są mocniej grawitacyjnie związane z gwiazdą i punktowe oddziaływanie grawitacyjne białego karła może nie być wówczas wystarczające dla kontynuowania mechanizmu akrecji). W pierwszej połowie XIX w. mierzono paralaksy do bliskich Słońcu gwiazd ciągu głównego.

2.

Friedrich Wilhelm Bessel w 1838 r. podał wielkość paralaksy dla gwiazdy 61 Cygni (czerwony karzeł odległy o11,4 lat świetlnych od Słońca i o jasności siedmiokrotnie niższej od słonecznej);

Thomas Henderson w 1839 r. podał wielkość paralaksy dla gwiazdy alfa Centauri (żółty karzeł takiego samego typu widmowego i podobnych parametrach fizycznych jak Słońce, odległy o 4,4 roku światła);

Friedrich von Struve w 1840 r. podał wielkość paralaksy dla gwiazdy alfa Lyrae (Wega); Wega jest karłem o białym widmie , o jasności 40 -krotnie większej niż Słońce, odległy o 25 lat świetlnych (nie mylić z “białym karłem” – dogasającym jądrem umarłej gwiazdy).

3.

Przesunięcie kątowe; aby je zarejestrować potrzebne są zazwyczaj długoletnie obserwacje, których skumulowanym efektem jest pomiar zmiany położenia obserwowanego obiektu. Pierwszą w ten sposób zmierzoną odległość miała najbliższa Słońca gromada gwiezdna, czyli Hiady w konstelacji Byka. Gromada tworzy głowę Byka w konturze tej konstelacji i jest oddalona o ok. 150 lat świetlnych od Słońca. Natomiast dokładna (średnia) odległość do Hiad (plus minus 1 rok światła) została zmierzona dopiero w końcu XX w. w na podstawie danych fotometrycznych zebranych przez satelitę HIPPARCOS.

4.

Obłoki Magellana – Wielki (LMC) i Mały (SMC), widoczne gołym okiem galaktyki satelitarne do Drogi Mlecznej, oddalone od niej o ok. 160.000 lat światła (Wielki) oraz ok. 200.000 l.św. (Mały). Zostały tak nazwane na cześć podróżnika i odkrywcy – Ferdynanda Magellana w XVI wieku. Poprzednio Europejczycy nazywali je Obłokami Przylądka (Amerigo Vespucci).

LMC (The Large Magellanic Cloud) – galaktyka nieregularna – jasność widoma 0,9 mag.;

średnica ok. 40.000 l.św.; masa – max. 1,0 procent masy Drogi Mlecznej, tj. 6 -10 mld mas Słońca. Szacuje się, iż zawiera ok. 30 mld gwiazd;

SMC (The Small Magellanic Cloud) – nieregularna galaktyka karłowata – jasność widoma 2,4 mag.; średnica ok. 15.000 lat światła; masa ok. 20% masy LMC (wg szacunków zawiera ok. 3 mld gwiazd);

5.

Delta Cephei – bardzo jasny żółty nadolbrzym w konstelacji Cefeusza, odległy od Słońca o ok. 900 lat światła, o okresie pulsacji wynoszącym 5,37 dnia, zmieniający swoją objętość oraz temperaturę w zakresie 5.500 K – 6.800 K i zmieniający ok. 2,5-krotnie siłę jasności widomej (w zakresie od 3,5 do 4,5 magnitudo). Delta Cephei jest systemem trzech gwiazd, główny składnik świeci ok. 3000 razy jaśniej niż Słońce, promień ma ok. 30-40 razy większy od Słońca, zaś masę ok. 5 razy większą);

6.

Świeca standardowa – obiekt o znanej gwiazdowej jasności absolutnej i odległości, służący do obliczania odległości do innych obiektów, których znanym parametrem jest tylko jasność widoma (obserwowana).

W galaktyce Drogi Mlecznej oraz pobliskich galaktykach rolę świec standardowych pełnią gwiazdy rodzaju cefeida i RR Lyrae. Określanie odległości za pomocą RR Lyrae jest możliwe do odległości w granicach kilku milionów lat świetnych, a za pomocą cefeid nawet do 50-60 milionów l. św. Natomiast na odległościach kosmologicznych (setki milionów i miliardy lat światła) rolę świec standardowych pełnią wybuchy supernowa typu Ia, (które mają bardzo zbliżoną jasność absolutną w maksimum), jak również rolę takich świec mogą spełniać najjaśniejsze galaktyki w grupach (gromadach) galaktyk.

7.

Cefeidy są to stare gwiazdy (wiek co najmniej 10 mld lat), które w swojej ewolucji minęły już fazę ciągu głównego (okres w którym gwiazda stabilnie spala wodór) i np. stały się czerwonymi olbrzymami. Po zejściu z ciągu głównego gwiazda zaczyna się najpierw kurczyć, wówczas rośnie jej temperatura. Ciepło przepływa (konwekcja) do zewnętrznych warstw atmosfery gwiazdy, gdzie znajdują się pojedynczo zjonizowane atomy helu (atom pojedynczo zjonizowany to atom z niedoborem jednego elektronu). Wzrost temperatury, a w jej konsekwencji szybkości ruchu cząstek w atmosferze gwiazdy i ich energii powoduje, że z atomów helu wybijany jest kolejny elektron i atomy helu znajdują się w stanie podwójnej jonizacji. W takim stanie atomy helu jeszcze wydajniej absorbują ciepło do chwili, gdy zewnętrzne warstwy atmosfery gwiazdy stają się nieprzepuszczalne dla dalszej konwekcji ciepła, otulając gwiazdę, niczym kokonem. Wówczas dostarczana wciąż energia cieplna zaczyna rozpychać zewnętrzną powłokę atmosfery gwiazdy. Gwiazda puchnie, gdyż rozszerza swoje rozmiary (promień) , niekiedy nawet stokrotnie. Taki wzrost objętości gwiazdy powoduje spadek temperatury w radykalnie zwiększonej objętości jej atmosfery, gwiazda się ochładza i staje się na powrót przezroczysta dla procesów konwekcji cieplnej. Atomy helu powracają do stanu pojedynczej jonizacji i gwiazda zaczyna się ponownie kurczyć. Cykl zaczyna się od początku. Procesy puchnięcia (rozdymania) i kurczenia atmosfery gwiezdnej sa powodem zmianami jej jasności. Najbliższą cefeidą jest Gwiazda Polarna (Polaris) w konstelacji Małego Psa , biało-żółty nadolbrzym odległy ok. 440 lat świetlnych od Słońca. Obserwacje wskazują, iż pulsacje tej gwiazdy zanikają i przestanie być niebawem (jak na kosmiczne standardy) cefeidą;

8.

RR Lyrae – gwiazda zmienna w konstelacji Lutni (Lyra), odległa od Słońca o ok. 850 lat światła, niewidoczna gołym okiem (jasność widoma waha się w granicach plus 7,06 do plus 8,12 magnitudo), o jasności absolutnej 0,34 mag., o mocy promieniowania w zakresie światła widzialnego ok. 50 razy większej od Słońca, o okresie zmienności ok. 13 godzin. Okres zmienności gwiazd typu RR Lyrae wynosi max. 1,5 dnia, a różnice jasności widomej sięgają max. ok. 1 magnitudo (mag.). Wszystkie gwiazdy typu RR Lyrae mają wartość jasności absolutnej w granicach 0,3 – 0,6 mag., podczas gdy cefeidy są znacznie jaśniejsze,

a rozpiętość wartości dla ich jasności absolutnej osiąga nawet kilka magnitudo;

9.

Wielka Mgławica – M31, olbrzymia galaktyka spiralna, znajdująca się najbliżej Drogi Mlecznej samodzielna galaktyka. Do 2009 r. uchodziła za największą i najbardziej masywną galaktykę w Lokalnej Grupie Galakty., Oszacowano jej średnicę na 50,0% większą od Drogi Mlecznej i, stosownie do tego, większą masę. Ostatnio opracowane dane uzyskane w ramach misji kosmicznych obserwatoriów (Chandra i Spitzer) wskazują, iż szacowana dotychczas szybkość rotacji naszej galaktyki (Droga Mleczna) jest o 50-60% wyższa, co oznaczało by konieczność przeszacowania jej masy o taki sam wskaźnik. Tym samym Droga Mleczna miałaby rozmiary i masę porównywalne z M 31. Wielka Mgławica w konstelacji Andromedy jest najdalej położonym obiektem we Wszechświecie (dystans ok. 2,2 miliona lat światła od centrum Drogi Mlecznej) widocznym z powierzchni Ziemi okiem nieuzbrojonym.

10.

Mt. Palomar Observatory – położone na górze Palomar w Kalifornii, wyposażone w jeden z największych teleskopów zwierciadlanych (średnia zwierciadła 508 cm). Był to największy teleskop do czasu uruchomienie w latach 1992-1996 zespołu dwóch teleskopów Keck’a, zlokalizowanych powyżej 4.000 m npm. na szczycie wygasłego wulkanu na Hawajach (Mauna Kea), posiadających średnice luster po 10,0 m. Teleskop dla obserwatorium na górze Palomar ufundował George Ellery Hale, dlatego nazwany jest teleskopem Hale’a. Obserwatorium Mt. Palomar tworzy zespół obserwacyjny wraz z obserwatorium Mt. Wilson. Utrzymanie i korzystanie z Teleskopu Hale’a należy do konsorcjum trzech placówek naukowo-badawczych. Są nimi: Kalifornijski Instytut Technologiczny (Caltech), Uniwersytet Cornell oraz Jet Propulsion Laboratory. Teleskop Hale’a ma lustro (zwierciadło) odlane z 17 ton szkła kwarcowego (wykonane w Saint Gobain we Francji), natomiast cały teleskop waży ok. 400 ton;

babylonianempirelotniowa-przepowiednia-rothschildow-z-roku-2012

Data: 9 Maggio 2024 Author: Uczta Baltazara

FOTO: Okładka gazety The Economist z 22 grudnia 2012 roku: Hamas i Bibi Netanyahu walczący na paralotniach.

Czy okładka magazynu The Economist z roku 2012 przewiduje atak Hamasu z wykorzystaniem lotni? – Nie, ona niczego nie “przewiduje”. Czy sprawdziliście, kim są właściciele i dyrektorzy zarządu The Economist? – Są nimi między innymi Rothschildowie. Po prostu, oni mówią wprost o swoich planach.

Towarzyszący rysunkowi artykuł, który traktowany jest jak przewodnik turystyczny, mówi, że najszybszą drogą do piekła jest ciągłe popełnianie grzechów głównych bez odczuwania wyrzutów sumienia.

Władimir Putin został przedstawiony w piekle, gdzie wraz z syryjskim prezydentem Baszarem Assadem, irańskim prezydentem Mahmudem Ahmadineżadem, północnokoreańskim przywódcą Kim Dzong Unem oraz euro płynie w ognistej rzece pod nagłówkiem “Orientacyjny przewodnik do Piekła”.

Na rysunku obecny jest także prezydent USA Barack Obama i kanclerz Niemiec Angela Merkel; Obama pędzi w kierunku Putina na motorówce, a Merkel siedzi smutna na torach kolejowych nad rzeką Styks.

Całą tę chaotyczną scenę obserwuje diabeł z egzemplarzem The Economist w ręku.

INFO: znalezione w Sieci

9.05.2024 majstersztyk-tuska-rozwiazal-problem-niemcow-co-zrobic-z-uzywanymi-elektrykami

Nowy rządowy program, który ma wejść w życie jeszcze w tym roku, przewiduje rekordowe dopłaty do zakupu samochodów elektrycznych. Szef Nowej Nadziei Sławomir Mentzen twierdzi, że jest to działania głównie na korzyść Niemiec.

W środę w Katowicach szefowa MFiPR Katarzyna Pełczyńska-Nałęcz jako inną zmianę podejścia do KPO wskazała zastąpienie w rewizji zakazów czy nakazów – wsparciem. Przykłady to przekierowanie środków na ważne społecznie obszary z części pożyczkowej do dotacyjnej (np. opieka długoterminowa w szpitalach), a także usunięcie podatku od używania samochodów spalinowych i wprowadzenie dopłat do pojazdów elektrycznych.

Minister argumentowała, że to założenie jest tak pomyślane, aby nie powodować wykluczenia komunikacyjnego osób mniej zamożnych lub w obszarach niemetropolitalnych. Jednocześnie wsparcie elektryków jest profilowane: kierowane na pojazdy ze średniej półki, wyższe w przypadku jednoczesnego złomowania pojazdów nieekologicznych.

– I kolejny klocek do układanki: jeżeli inwestycja w produkowany w Polsce częściowo z polskimi technologiami samochód elektryczny Izera okaże się możliwa do realizacji i opłacalna, to oczywiście jest idealne zamknięcie koła, w którym te dopłaty od jakiegoś momentu idą już na samochody produkowane w Polsce. To jest idealne rozwiązanie: środki na Izerę pozostają w KPO – bo jest masa dezinformacji, że to zostało skasowane, a to jest nieprawda – podkreśliła feministra funduszy.

Rządowy pomysł w swoich mediach społecznościowych skomentował Sławomir Mentzen. Szef Nowej Nadziei i współprzewodniczący Konfederacji twierdzi, że program pomoże głównie Niemcom – pozbyć się używanych samochodów elektrycznych.

„Ale te 1,6 mld zł na dopłaty do zakupu używanych elektryków z Niemiec to majstersztyk. Nie wiedzieli Niemcy co robić z tymi używanymi elektrykami, których nikt nie chciał, to im Tusk problem rozwiązał :)” – napisał na X polityk.

Za lichwiarski kredyt z KPO dopłacą do… wraków z Niemiec, byle elektrycznych. Ci ludzie całkowicie i ostatecznie zwariowali – skomentował z kolei Tomasz Sommer: [[To woryginale md]

Sekty w medycynie. J. Jaśkowski MD.PhD.MS.

Nowa medycyna czy zniewolenie społeczeństwa?

Podsumowanie.

Nauka jest to wiedza, która nieustannie się zmienia. Napisanie przed 30- laty pierwszego artykułu o oszustwach przemysłu farmaceutycznego, zepchnęło mnie w ślepy zaułek. Prawie „codziennie” odkrywam nowe sytuacje, jednoznacznie wskazujące, że dziedzina wiedzy zwana medycyną, przestała służyć społeczeństwu, jako dział przywracający im zdrowie i możliwość zaspokajania swoich potrzeb, a sprowadziła ludność do niewolniczej pracy, w celu wzrostu niekontrolowanych podatków – vide VAT, zapewniających zysk wąskiej grupie tzw. cwaniaków, czyli konsorcjum książąt niemieckich, ustabilizowanych w olbrzymich grupach kapitałowych zwanych BlackRock, Vongard, State i kilku innych. W każdej z tych grup, ok. 10 – 15% akcji ma House of Windsor, czyli Dom Saxe-Coburg-Gotha, Obecnie na czele tej grupy stoi najprawdopodobniej król Karol III angielski.

Ale od początku.

Pierwszą chorobą, rzekomo wirusową, wprowadzoną na rynki światowe, było „Wiotkie porażenie kręgosłupa” zwane także „Chorobą Heinego -Medina” czy „Poliomyelitis”.

A zaczęło się to tak:

Po raz pierwszy w nowożytnej historii, niemiecki lekarz Adolf von Strumpell [1853-1925] opisując leczony przypadek, podejrzewał chorobę zakaźną. Kiedy w okolicach Sztokholmu wystąpiło ok. 1031 podobnych przypadków w 1905 roku, taki paraliż uznano za epidemię.

W 1908 roku austriaccy lekarze; Karol Landsteiner [1868 – 1943] i Irwin Popper [1879 -1935], jako przyczynę podali filtrowanego wirusa, ponieważ rzekomo udało im się zakazić małpę wydzieliną wirusa, wolną od bakterii.

W USA niejaki Simon Flexner [1863 – 1946], ten sam od brata ustanawiającego procedury medyczne dla Rockefellera, natychmiast potwierdził to ustalenie.

Był to drugi przypadek po ospie, że pomimo braku dowodów medycznych, objawy kliniczne przypisano wirusowi.

Przypomnę, że nie wykonano testów Kocha, a mikroskop elektronowy wynaleziono dopiero w 1954 roku.

Tak narodziła się nowa specjalizacja zwana wirusologią, która z każdym rokiem przekształcała się w sektę, ponieważ w owym czasie nie można było wyizolować żadnego wirusa. Była jednakże bardzo na rękę rozwijającej się chemii w rolnictwie. Pestycydy, herbicydy itd. były i są doskonałym źródłem zysków, a nie powodują żadnych strat i dzięki tej sekcie, przemysł rolno – chemiczny nie ponosi kosztów powikłań u ludzi.

Dziwnym bowiem trafem, dwa pierwsze przypadki opisane powyżej, miały miejsce w Europie i Vermont po wprowadzeniu arsenianu ołowiu, jako środka owadobójczego w 1892 roku.

Arsenian ołowiu wpływa na komórki układu nerwowego, powodując paraliż opisywany jako „polio”. Jak stwierdzono, paraliż miał miejsce u dzieci mających kontakt z arsenianem ołowiu.

W Stanach Zjednoczonych od 1916 roku zachorowania koncentrowały się na północno – wschodnim wybrzeżu, zwłaszcza w rejonie Nowego Jorku i Long Island. Analiza wykazała, że cukier pochodził z hawajskich plantacji trzciny cukrowej, na których masowo stosowano arsenian ołowiu od 1915 roku. Największe na świecie rafinerie znajdowały się w Queens i Yonkers. Te tereny, wraz z Brooklinem, odnotowały największą liczbę zachorowań. Zachorowania występowały masowo latem, w czasie wakacji, kiedy to dzieciaki objadały się watą cukrową.

Choroba w Danii i Niemczech rozpowszechniła się dopiero ok. lat 30. [~1930]

W Związku Radzieckim choroba pojawiła się dopiero po 1949 roku, po sprowadzaniu tych środków chemicznych z zachodu.

W Azji i Afryce do lat 1950 chorowali tylko biali mieszkańcy z ośrodków miejskich.

Po II wojnie światowej pojawiało się coraz więcej zachorowań. Zostało to powiązane z wprowadzeniem na rynek w czasie wojny, innego środka chemicznego zwanego dichlorodifenylotrichloroetanem, czyli popularnego DDT.

W latach 50. XX wieku, stosowano go w postaci aerozoli nawet w przedszkolach i szkołach, nie wspominając o wojsku oraz o wielkich obszarach „zamieszkiwanych” przez komary.

W Polsce stosowano DDT w szkołach i na koloniach w walce z wszawicą, posypując po prostu głowy dzieci tym świństwem. To, że przy okazji wdychały to to? A kogo to obchodziło. Wszy ginęły, a wirusa i tak nikt nie widział. A że czasami dzieci chorowały??